Para os varejistas, é crucial ter uma função de pesquisa poderosa para seus sites e aplicativos móveis. No entanto, a maioria das experiências de pesquisa atuais são um tanto básicas e limitadas, retornando principalmente uma lista de resultados classificados com base na relevância das palavras-chave. E normalmente, os clientes têm apenas uma vaga ideia do que desejam, em vez de um item específico em mente. Por exemplo, eles podem estar procurando uma bela mesa de jantar, mas não têm certeza sobre o estilo, tamanho, formato ou outros detalhes. Não é de surpreender que muitos clientes abandonem um site de varejo após tentativas de pesquisa malsucedidas. Isto não só os priva de uma experiência de compra potencialmente satisfatória, mas também representa uma oportunidade perdida para os retalhistas.

Hoje, temos o prazer de apresentar uma nova experiência de pesquisa para varejistas que usam IA generativa com Vertex AI e ElasticSearch. Essa interface aprimorada oferece aos usuários uma experiência interativa e conversacional que resume dados pertinentes e adapta as respostas com base nas necessidades exclusivas de cada cliente, ao mesmo tempo em que se baseia no conhecimento público e interno do varejista. Isso pode incluir, por exemplo, conhecimento público da experiência do varejista:

- Diretrizes e cenários comuns para resolver sua necessidade específica

- Resumo das avaliações de produtos similares que atendem à sua solicitação

- Referências públicas sobre como construir, combinar ou usar os produtos

- etc.

Ou o conhecimento pode ser privado do varejista:

- A localização geral de um usuário e os regulamentos locais que podem ser aplicados a ele

- Catálogo de produtos atualizado em tempo real, estoque próximo e preços

- Documentação e conhecimento privados

- etc.

Em vez de apenas gerar uma lista simples de itens relevantes, essa experiência de pesquisa avançada funciona como um representante de vendas de concierge com profundo conhecimento do domínio. Ele auxilia e orienta os clientes durante toda a jornada de compra, criando uma experiência de compra mais envolvente e eficiente.

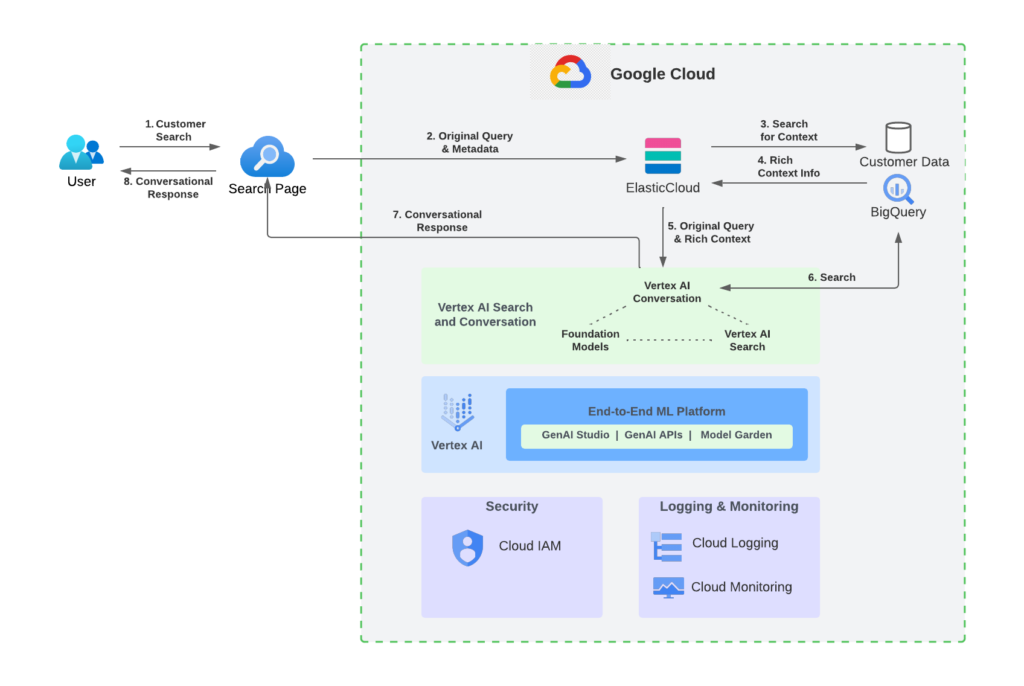

Arquitetura

O diagrama abaixo ilustra a integração dos serviços generativos de IA e dos recursos de pesquisa Elastic do Google Cloud, que formam a base para essa nova experiência do usuário.

A vida de uma consulta de pesquisa

Nesta arquitetura, uma consulta de pesquisa ocorre em duas fases amplas.

1. Processamento e enriquecimento inicial da consulta

Um usuário inicia o processo enviando uma consulta ou pergunta na página de pesquisa.

Essa consulta, junto com outros metadados relevantes, como geolocalização geral, informações de sessão ou quaisquer outros dados considerados significativos pelo varejista, é então encaminhada para o Elastic Cloud.

O Elastic Cloud usa essa consulta e metadados para realizar pesquisas nos dados do cliente específicos do domínio, reunindo informações de contexto ricas no processo:

- Dados relevantes em tempo real de diversas fontes de dados internas da empresa (ERP, CRM, WMS, BigQuery, GCS etc.) são continuamente indexados no Elastic por meio de seu conjunto de integrações, e os embeddings relacionados são criados por meio do modelo de transformador de sua escolha ou do modelo de transformador construído -em MAIS . A inferência pode ser aplicada automaticamente a cada fluxo de dados por meio de pipelines de ingestão .

- Os embeddings são então armazenados como vetores densos no banco de dados de vetores da Elastic .

- Usando a API de pesquisa , o elasticsearch começa a executar a pesquisa entre seus índices com pesquisa de texto e pesquisa vetorial em uma única chamada. Enquanto isso, ele gera vetores no texto de consulta do usuário que recebe.

- Os embeddings gerados são comparados por meio de pesquisa vetorial com os vetores densos de dados previamente ingeridos com kNN (algoritmo K-Nearest Neighbors).

Uma saída é produzida combinando resultados de pesquisa semântica e de texto, com a classificação híbrida Reciprocal Rank Fusion (RRF).

2. Produza resultados usando geração AI

A consulta original e as informações de contexto avançadas recém-obtidas são encaminhadas para o Vertex AI Conversation. IA conversacional é uma coleção de ferramentas, soluções e APIs de IA conversacional, tanto para designers quanto para desenvolvedores. Neste design, usaremos o Dialogflow CX no Vertex AI Conversation para a IA conversacional e integraremos com sua API .

Ao usar a API Dialogflow CX, seu sistema precisa:

- Construa um agente.

- Fornece uma interface de usuário para usuários finais.

- Chame a API Dialogflow para cada turno de conversa para enviar a entrada do usuário final para a API.

- A menos que as respostas do seu agente sejam puramente estáticas (incomum), hospede um serviço de webhook para lidar com o atendimento habilitado para webhook.

Para obter mais detalhes sobre como usar a API, consulte Início rápido da API Dialogflow CX .

O módulo Conversational AI atinge os endpoints do modelo LLM implantado em seu locatário Vertex AI para gerar a resposta completa em linguagem natural, mesclando o conhecimento do modelo com os dados privados fornecidos pela Elastic. Isto é conseguido por:

- Selecionando seu modelo favorito do Model Garden

- Se necessário, ajuste-o nas tarefas do seu domínio

- Implantar o modelo em um endpoint no seu projeto do Google Cloud

- Consumindo o endpoint dos fluxos de trabalho do Dialogflow

Para gerenciar o controle de acesso a dados e garantir a privacidade, a Vertex AI emprega IAM para gerenciamento de acesso a recursos. Você tem flexibilidade para regular o acesso no nível do projeto ou do recurso. Para obter mais detalhes, consulte a documentação do Google . Consulte a seção abaixo para obter mais detalhes sobre esta etapa.

O Dialogflow torna a experiência do chatbot acionável com respostas conversacionais, fornecendo ações relevantes ao usuário dependendo do contexto (por exemplo, fazer um pedido ou navegar até o conteúdo)

A resposta é retransmitida de volta ao usuário.

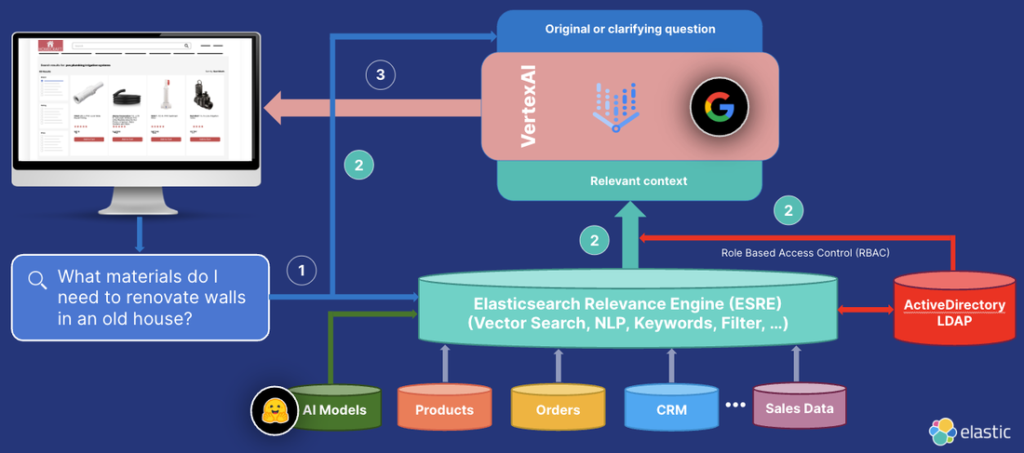

Elastic Cloud: crie contexto a partir de dados corporativos

Ao usar IA generativa, as janelas de contexto ajudam a passar dados privados adicionais, solicitados pelo usuário, em tempo real, para o modelo no momento da consulta, em paralelo com a pergunta que você está enviando. Isso permite que os usuários recebam melhores respostas como resultados, com base no conhecimento público em que o LLM é treinado, mas também no espaço do domínio específico que você forneceu. A eficácia da Gen AI depende muito da engenharia de entrada, e o contexto realmente melhora a qualidade dos resultados.

Depois que o usuário envia sua pergunta por meio da caixa de pesquisa do site, o Elasticsearch se aprofunda em sua base de conhecimento interna, procura conteúdo relacionado e o retorna para processamento adicional no modelo generativo que o aguarda. Pesquisar informações dentro do seu negócio, a partir de diversas fontes de dados, é a finalidade do Elasticsearch.

Mas quando o tamanho da janela de contexto é limitado , os modelos comuns permitem apenas o processamento de alguns milhares de tokens. Portanto, é impossível passar todo o conjunto de dados corporativos para cada consulta. Além disso, quanto maior a consulta enviada pelo usuário, maior será o impacto no desempenho e no custo. Você precisa filtrar e encontrar o contexto relevante antes mesmo de enviar a consulta para a IA generativa.

O Elasticsearch Relevance Engine (ESRE) é um pacote construído com anos de pesquisa e desenvolvimento e experiência da Elastic no espaço de pesquisa e IA para ajudar os clientes a aproveitar o poder do Elasticsearch com recursos de machine learning de ponta. O ESRE permite a recuperação rápida de resultados relevantes de conjuntos de dados enormes e heterogêneos usando recursos avançados de pesquisa vetorial em texto, imagens, áudio e vídeo, tudo isso combinado com a pesquisa de texto clássica em índices do Elasticsearch. Com o ESRE, tudo é relevante e também protegido graças à segurança em nível de documento e campo aplicável a todo o conteúdo gerenciado pela Elastic.

Com a Elastic, você tem a liberdade de escolher e executar seus próprios modelos de Machine Learning (ML) para criar embeddings ou para extração de recursos, permitindo assim total controle e personalização dependendo do seu domínio, linguagem e tipo de dados específicos. A Vertex AI pode então ajudá-lo a criar seus modelos de transformadores para importar para a plataforma Elastic. Não se preocupe se você quiser começar rapidamente, sem habilidades internas de ML: o modelo de recuperação ELSER pronto para uso permite que você comece a trabalhar com apenas alguns cliques.

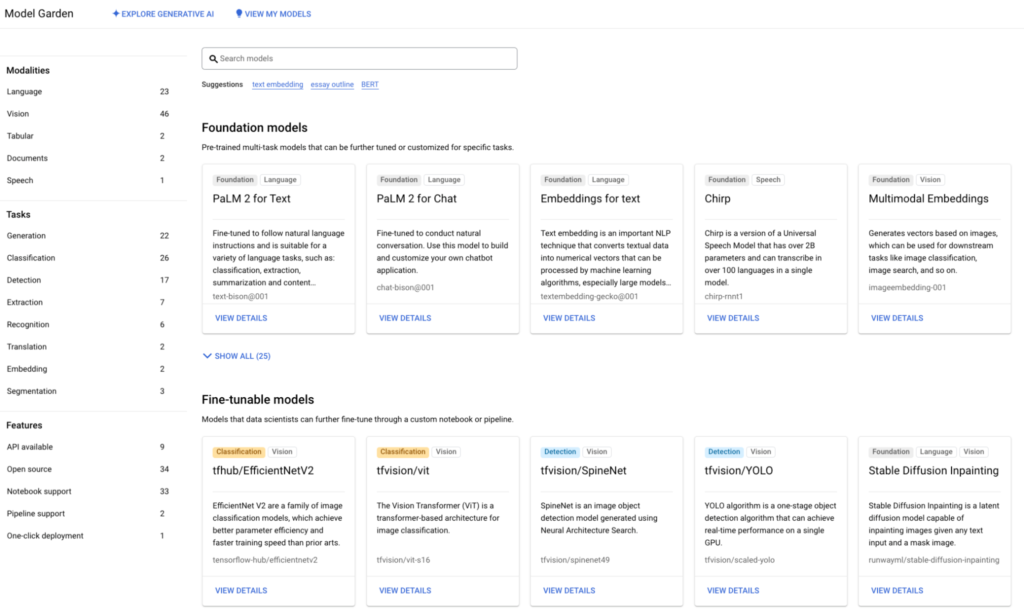

Ajustando modelos básicos na Vertex AI

Estratégias de design imediato e janelas de contexto podem não ser suficientes para adaptar o comportamento do modelo.

Model Garden : Vertex AI Model Garden é um repositório rico de modelos de ML pré-construídos que atendem a um conjunto diversificado de casos de uso. Esses modelos prontos para empresas foram meticulosamente testados e otimizados para atender às necessidades de desempenho e precisão dos aplicativos empresariais. Eles oferecem acesso fácil de usar por meio de APIs, notebooks e serviços da web. Projetados com a escalabilidade em mente, esses modelos podem lidar com grandes volumes de dados e atender vários usuários. Além disso, eles são de acesso gratuito e atualizados regularmente com novos modelos.

Personalização do modelo : os varejistas podem preferir interagir com modelos básicos para adaptá-los às suas necessidades exclusivas. O ajuste fino é uma abordagem eficiente e econômica para melhorar o desempenho específico de uma tarefa de um modelo ou atender a requisitos de saída distintos quando as instruções não são adequadas. Mas desenvolver e treinar novos modelos fundamentais desde o início pode custar caro. Técnicas como ajuste eficiente de parâmetros reduzem a sobrecarga ao implementar camadas adaptadoras sobre LLMs existentes. Essas camadas complementam os modelos com seus conhecimentos específicos ausentes, mantendo suas habilidades já estabelecidas.

Segurança e privacidade : embora os assistentes de IA do consumidor sejam normalmente robustos, o controle de seus recursos e segurança nem sempre está em suas mãos. Ter uma visão completa do uso dos seus dados e de como eles são armazenados é vital para a conformidade, a privacidade e a manutenção de uma vantagem competitiva. O Secure AI Framework do Google fornece padrões claros do setor para a criação e implantação de tecnologia de IA de maneira responsável. É por isso que a adoção de IA generativa para empresas por meio dos recursos Vertex AI do Google é tão inteligente.

Solução de nível empresarial : Vertex AI Generative AI Studio fornece acesso a modelos de ponta e permite a navegação por vários lançamentos e modificações. Depois de personalizados, você pode testá-los, implantá-los e integrá-los a outros aplicativos e plataformas hospedados no Google Cloud. Isso pode ser feito por meio do SDK da Vertex AI ou diretamente pelo console do Google Cloud, tornando-o fácil de usar para quase qualquer pessoa, mesmo sem conhecimento especializado em ciência de dados.

IA responsável : Com grande poder vem uma grande responsabilidade. Os LLMs têm a capacidade de traduzir idiomas, condensar texto e gerar escrita criativa, código e imagens, entre muitas outras tarefas. No entanto, sendo uma tecnologia emergente, as suas capacidades e aplicações em evolução podem levar a potenciais utilizações indevidas, aplicações incorretas e consequências inesperadas. Às vezes, esses modelos podem gerar resultados imprevisíveis, incluindo textos que podem ser ofensivos, insensíveis ou factualmente incorretos. O Google se dedica a promover o uso responsável dessa tecnologia, fornecendo recursos e filtros de segurança para proteger os usuários e garantir a conformidade com nossos princípios de IA e o compromisso com a IA responsável .

Próximos passos

Começar a criar seu próprio aplicativo de varejo voltado para o cliente com tecnologia de IA nunca foi tão fácil: dê uma olhada no repositório GitHub oficial da Elastic que ajuda você a criar e executar, com etapas guiadas, uma barra de pesquisa de comércio eletrônico com ESRE e Vertex AI .

Se você estiver interessado em explorar mais através de exemplos de código, o Google Lab fornece um guia completo intitulado Dialogflow CX: Construa um agente virtual de varejo . Para obter exemplos adicionais de designs de IA da geração Google, recomendamos que você visite nossa página ‘ Exemplos de IA generativa ‘.

Preocupado com o uso dos seus modelos e serviços da Vertex AI? Explore como a Elastic fornece uma plataforma de observabilidade completa que aproveita todos os seus logs, métricas e rastreamentos diretamente do pacote de operações do Google Cloud , graças a integrações nativas .

Não perca esta inovação revolucionária. Incentivamos você a explorar e adotar esta solução e começar a transformar as experiências de compra de seus clientes. A melhor maneira de começar é criar um cluster de teste gratuito de 14 dias no Elastic Cloud usando sua conta do Google Cloud ou assinar facilmente o Elastic Cloud por meio do Google Cloud Marketplace .

Texto por: Yang Li – Arquiteto de soluções em nuvem da equipe, Google Cloud e Valério Arvizzigno – Arquiteto de soluções sênior, Elastic.

Fonte: Google